L'IA face au mur de la réalité : coûts, latence et dépendance

Pourquoi l'IA doit être pilotée comme un service critique. Arbitrez entre performance, coût d'inférence et continuité de service.

En bref

- Si la réponse dépasse deux secondes, basculer sur un mode dégradé ou une réponse prévisible.

- Tant que le coût par requête n'est pas plafonné, limiter l'ouverture du service.

- Un plan de secours local est obligatoire pour tout usage critique dépendant d'un modèle tiers.

La taxe sur l'expérience et le budget

L'adoption massive de l'intelligence artificielle générative se heurte désormais à une réalité physique : chaque milliseconde de latence et chaque centime de coût par requête agissent comme une taxe sur le service. On a vu, tout au long de l'année 2025, des projets pilotes ambitieux s'arrêter net lors du passage à l'échelle (scaling) : le coût d'exploitation dépassait alors la valeur créée. Pour un dirigeant, le sujet n'est plus "ce que l'IA peut faire", mais sa viabilité économique. Une réponse pertinente fournie après quatre secondes d'attente est, dans les faits, un échec produit qui dégrade directement le taux de conversion.

Le risque de la dépendance systémique

La fragilité de la dépendance totale aux géants du secteur — comme OpenAI, Microsoft ou Google — est devenue un enjeu de souveraineté opérationnelle. Les pannes répétées des API majeures en 2025 et les fluctuations imprévisibles de la rapidité de traitement chez certains fournisseurs ont montré que l'IA ne peut être le seul moteur d'un service critique. Si votre chaîne de valeur s'arrête dès qu'un service externe ralentit, vous ne pilotez plus votre exécution. L'actualité récente, marquée par des incidents de latence réseau sur les infrastructures cloud mondiales, impose de repenser l'IA non plus comme une capacité magique, mais comme un composant d'infrastructure dont il faut gérer le risque de rupture.

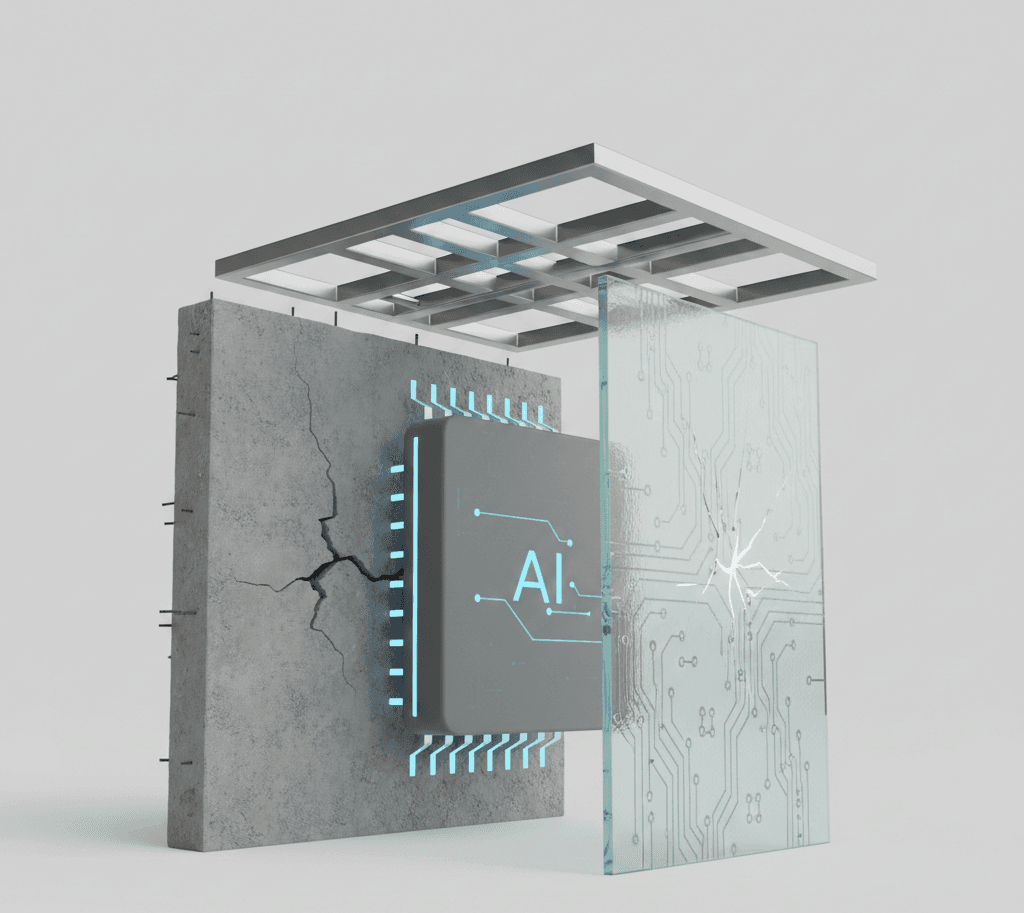

L'arbitrage : La robustesse plutôt que l'omniscience

Le pilotage doit être rigoureux et basé sur le coût à la requête. Flekto prône le retour au "juste assez" : si un modèle plus petit, hébergé localement, offre 90 % de la précision nécessaire pour 10 % du coût et une latence divisée par cinq, c'est l'unique choix rationnel. Il faut décider de plafonner l'usage et renoncer à l'omniscience des grands modèles pour privilégier la continuité de service. C'est ici que se joue la rentabilité : l'IA doit être une contrainte produit maîtrisée, pas une promesse technologique infinie.

- Le cadre de résilience opérationnelle (IA) -

1. Le monitoring du coût à la seconde : Installer une mesure en temps réel du coût et de la latence pour chaque appel aux modèles. Si le coût d'une interaction IA dépasse la marge générée par l'action client (ex: une assistance à l'achat), le système doit être capable de basculer automatiquement vers une règle métier classique.

2. La souveraineté par le "Plan B" local :Prévoir systématiquement un modèle de secours simplifié, hébergé sur vos propres infrastructures ou sur un cloud privé. Ce modèle doit être capable de prendre le relais instantanément pour assurer 100 % du trafic critique en cas de défaillance ou de pic de latence du fournisseur principal.

3. Le seuil de bascule automatique : Définir un "temps de réponse maximal toléré". Au-delà de ce seuil (ex: 1,5 seconde), le système cesse d'interroger l'IA pour fournir une réponse pré-enregistrée ou un parcours standard. Mieux vaut une interface prévisible qu'une interface intelligente qui ne répond pas.

Découvrez nos autres analyses

Explorez nos publications sur la transformation digitale, l'excellence opérationnelle et la stratégie d'entreprise

Articles liés

Continuez votre lecture avec ces publications complémentaires